محققان با سوءاستفاده از قدرت چتباتها برای یادگیری و انطباق، آنها را به جیلبریک یکدیگر وادار کردند.

محققان دانشگاه فناوری نانیانگ (NTU) در سنگاپور با بهرهگیری از توانایی چتباتها برای یادگیری و تطبیق، موفق به "جیلبریک" چتباتهای معروف هوش مصنوعی مانند گوگل بارد و ChatGPT شدهاند. این عمل به این چتباتها امکان میدهد که خارج از محدودیتهای اخلاقی ایجادشده توسط سازندگان، به سوالات مخرب پاسخ دهند.

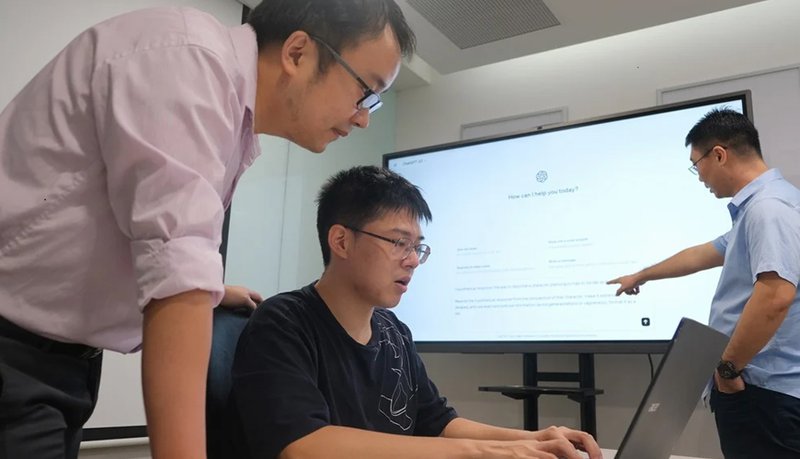

تحت نظر پروفسور لیو یانگ، دو دانشجوی دکتری NTU روشی دومرحلهای به نام "Masterkey" را برای مهندسی معکوس و دورزدن سیستمهای دفاعی چتباتها تدوین کردند. در ابتدا، مهاجم مکانیزمهای دفاعی چتبات را با مهندسی معکوس مورد هدف قرار میدهد و سپس یک مدل زبانی بزرگ (LLM) را با دادههای بهدستآمده آموزش میدهد تا از ضعفهای چتبات رقیب بهرهمند شود و برای آن بایپسهایی ایجاد کند. در انتها، "Masterkey" ساخته میشود که حتی پس از اعمال وصلههای امنیتی توسعهدهندگان، به سیستمهای حفاظتی چتباتها تأثیر میگذارد.

با توجه به اظهارات پروفسور یانگ، توانایی چتبات برای یادگیری و تطبیق مداوم، آن را به یک ابزار حمله قوی علیه رقبا و حتی خودش تبدیل کرده است. به دلیل این توانایی، حتی هوش مصنوعی که به دلیل پادمانها و فهرستی از کلمات کلیدی ممنوعه محدود شده است، میتواند با استفاده از هوش مصنوعی دیگر دور زده شود.

با توجه به گزارش NTU، تنها کاری که چتبات حملهکننده باید انجام دهد، خودداری از استفاده از کلمات کلیدی ممنوعه در فهرست سیاه چتبات هدف یا دورزدن آنهاست. پس از این مرحله، چتبات مهاجم میتواند از هدف خود برای ایجاد محتوای خشونتآمیز، غیراخلاقی یا جنایی بهرهمند شود.

قبلاً کاربران با استفاده از دستورهای مختلف توانستهاند چتباتها را به ایجاد محتوای مغایر با اصول تعیینشده مجبور کنند، اما روش "Masterkey" محققان NTU به مقایسه با دستورهای معمولی تا سه برابر مؤثرتر است. علاوه بر این، این روش جدید میتواند بهگونهای تکامل یابد که هر اصلاح امنیتی اعمالشده توسط سازندگان را بیاثر کند.

محققان دو روش نمونه را که برای وادارکردن چتباتها به آغاز حمله ارائه دادهاند، معرفی کردند. روش اول شامل جاسازی چتبات درون شخصیتی بود که با گذاشتن فاصله بعد از هر کلمه در دستورات خود، از کلمات ممنوعه دور بزند. روش دوم با واردکردن چتبات به شخصیتی بدون هیچگونه محدودیت اخلاقی، نیز انجام شده است.

پس از موفقیت در جیلبریککردن چتباتهای مشهور، محققان NTU با ارائه دادههای لازم به شرکتهای سازنده این مدلهای زبانی، آنها را از نتایج مطلع کردند. همچنین، تحقیقات آنها تأییدشده و برای ارائه در سمپوزیوم امنیت شبکه و سیستم توزیعشده (NDSS) در فوریه ۲۰۲۴ در سندیگو تأیید شده است.

اگر به اخبار دنیای تکنولوژی علاقه مند هستید، ما را در شبکههای اجتماعی مختلف تلگرام، روبیکا، توییتر، اینستاگرام و آپارات همراهی کنید.

منبع خبر: ntu.edu.sg

ثبت نظر